Diferenças entre edições de "Distribuição normal"

(→Distribuições relacionadas) |

|||

| (3 edições intermédias não estão a ser mostradas.) | |||

| Linha 10: | Linha 10: | ||

Se a [[variável aleatória]] <tex>X</tex> segue esta distribuição escreve-se: | Se a [[variável aleatória]] <tex>X</tex> segue esta distribuição escreve-se: | ||

| + | |||

:<tex>X</tex> ~ <tex>N(\mu, \sigma^2)</tex>. | :<tex>X</tex> ~ <tex>N(\mu, \sigma^2)</tex>. | ||

| Linha 32: | Linha 33: | ||

==Distribuições relacionadas == | ==Distribuições relacionadas == | ||

*<tex>R \sim \mathrm{Rayleigh}(\sigma^2)</tex> é a [[distribuição de Rayleigh]] se <tex>R = \sqrt{X^2 + Y^2}</tex> onde <tex>X \sim N(0, \sigma^2)</tex> e <tex>Y \sim N(0, \sigma^2)</tex> são duas distribuições normais independentes. | *<tex>R \sim \mathrm{Rayleigh}(\sigma^2)</tex> é a [[distribuição de Rayleigh]] se <tex>R = \sqrt{X^2 + Y^2}</tex> onde <tex>X \sim N(0, \sigma^2)</tex> e <tex>Y \sim N(0, \sigma^2)</tex> são duas distribuições normais independentes. | ||

| − | *<tex>Y \sim \chi_{\nu}^2</tex> é a [[distribuição Chi-quadrado]] com <tex>\nu</tex> | + | |

| − | *<tex>Y \sim \mathrm{Cauchy}(\mu = 0, \theta = 1)</tex> é a [[distribuição de Cauchy]] se <tex>Y = X_1/X_2</tex> para <tex>X_1 \sim N(0,1)</tex> e <tex>X_2 \sim N(0,1)</tex> são duas distribuições normais padrão independentes. | + | *<tex>Y \sim \chi_{\nu}^2</tex> é a [[distribuição Chi-quadrado]] com <tex>\nu</tex> graus de liberdade se <tex>Y = \sum_{k=1}^{\nu} X_k^2</tex> em que <tex>X_k \sim N(0,1)</tex> para <tex>k=0,1,\cdots,\nu</tex> são distribuições normais padrão independentes. |

| + | |||

| + | *<tex>Y \sim \mathrm{Cauchy}(\mu = 0, \theta = 1)</tex> é a [[distribuição de Cauchy]] se <tex>Y = X_1/X_2</tex> para <tex>X_1 \sim N(0,1)</tex> e <tex>X_2 \sim N(0,1)</tex> são duas distribuições normais padrão independentes. | ||

| + | |||

*<tex>Y \sim \mbox{Log-N}(\mu, \sigma^2)</tex> é a [[distribuição log-normal]] se <tex>Y = e^X</tex> e <tex>X \sim N(\mu, \sigma^2)</tex>. | *<tex>Y \sim \mbox{Log-N}(\mu, \sigma^2)</tex> é a [[distribuição log-normal]] se <tex>Y = e^X</tex> e <tex>X \sim N(\mu, \sigma^2)</tex>. | ||

| − | |||

| − | |||

| + | *Relação com distribuição Lévy skew alpha-stable: se <tex>X\sim \textrm{Levy-S}\alpha\textrm{S}(2,\beta,\sigma/\sqrt{2},\mu)</tex> então <tex>X \sim N(\mu,\sigma^2)</tex>. | ||

| + | |||

| + | *[[Distribuição normal truncada]]: Se <tex>X \sim N(\mu, \sigma^2)</tex> então, truncando para valores entre <tex>A</tex> e <tex>B</tex> temos uma [[variável aleatória contínua]] com média <tex>E(X)=\mu + \frac{\sigma(\phi_1-\phi_2)}{T}</tex>, em que <tex>T=\Phi\left(\frac{B-\mu}{\sigma}\right)-\Phi\left(\frac{A-\mu}{\sigma}\right)</tex>, <tex>\phi_1=f\left(\frac{A-\mu}{\sigma}\right)</tex> e <tex>\phi_2=f\left(\frac{B-\mu}{\sigma}\right)</tex>, sendo <tex>f(\cdot)</tex> a [[função densidade de probabilidade]] e <tex>\Phi(\cdot)</tex> a [[função de probabilidade acumulada]] de uma distribuição normal padrão. | ||

==Simulação== | ==Simulação== | ||

| − | Implementações computacionais do [[Método de Monte Carlo]] normalmente precisam simular várias variáveis aleatórias normais. Muitos programas e pacotes não conseguem simular diretamente a normal, mas tem simuladores da [[distribuição uniforme]]. Uma forma rápida e prática de gerar normais a partir da uniforme é a | + | Implementações computacionais do [[Método de Monte Carlo]] normalmente precisam simular várias variáveis aleatórias normais. Muitos programas e pacotes não conseguem simular diretamente a normal, mas tem simuladores da [[distribuição uniforme]]. Uma forma rápida e prática de gerar normais a partir da uniforme é a transformação de Box-Muller: sejam <tex>U_1</tex> e <tex>U_2</tex> valores independentes gerados pela distribuição uniforme entre 0 e 1. Então: |

| Linha 56: | Linha 61: | ||

| − | {{Wikipedia| | + | {{Wikipedia|Distribuição normal}} |

[[Categoria:Conceitos]][[Categoria:Estatística]] | [[Categoria:Conceitos]][[Categoria:Estatística]] | ||

Edição atual desde as 18h29min de 7 de dezembro de 2008

A distribuição normal é a distribuição de probabilidade mais frequente em estatística. Foi desenvolvida pelo matemático francês Abraham de Moivre. As suas características fundamentais são a média e o desvio padrão.

A distribuição normal é a distribuição de probabilidade mais frequente em estatística. Foi desenvolvida pelo matemático francês Abraham de Moivre. As suas características fundamentais são a média e o desvio padrão.

Índice

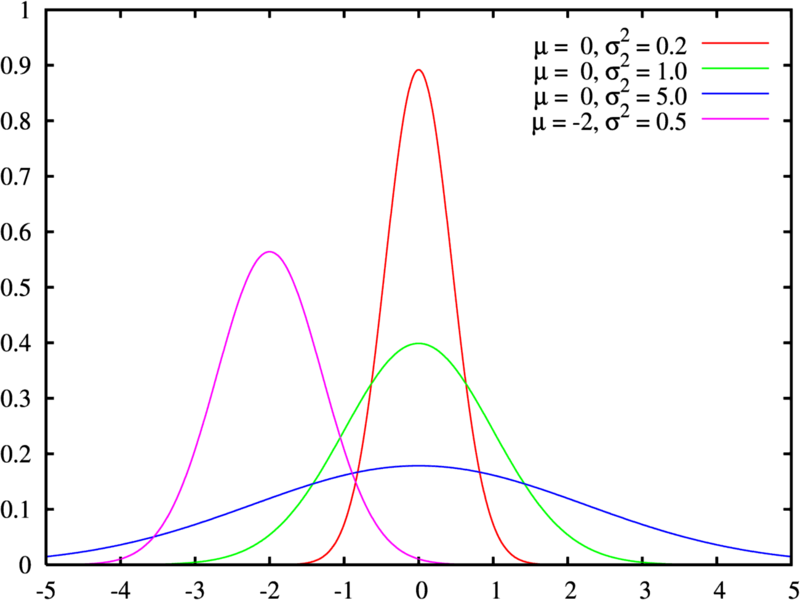

Função de densidade de probabilidade

A função densidade de probabilidade da distribuição normal com média e variância

(de forma equivalente, desvio padrão

) é assim definida,

Se a variável aleatória segue esta distribuição escreve-se:

~

.

Se e

, a distribuição é chamada de distribuição normal padrão e a função de densidade de probabilidade reduz-se a,

Propriedades

- Se X segue uma distribuição normal, então a X + b também segue.

- Se X e Y são distribuições normais, então sua soma U = X + Y e diferença V = X - Y também são distribuições normais.

- Se X e Y são independentes, então U e V também serão independentes.

- A soma de uma grande quantidade de variáveis aleatórias (com algumas restrições) tende a uma distribuição normal - o significado mais preciso disto é o Teorema do Limite Central.

- A distribuição normal é infinitamente divisível, no seguinte sentido: se X é uma variável aleatória que segue uma distribuição normal e n é um número natural, então existem n variáveis aletórias

, independentes e identicamente distribuídas, tal que

Distribuições relacionadas

é a distribuição de Rayleigh se

onde

e

são duas distribuições normais independentes.

é a distribuição Chi-quadrado com

graus de liberdade se

em que

para

são distribuições normais padrão independentes.

é a distribuição de Cauchy se

para

e

são duas distribuições normais padrão independentes.

é a distribuição log-normal se

e

.

- Relação com distribuição Lévy skew alpha-stable: se

então

.

- Distribuição normal truncada: Se

então, truncando para valores entre

e

temos uma variável aleatória contínua com média

, em que

,

e

, sendo

a função densidade de probabilidade e

a função de probabilidade acumulada de uma distribuição normal padrão.

Simulação

Implementações computacionais do Método de Monte Carlo normalmente precisam simular várias variáveis aleatórias normais. Muitos programas e pacotes não conseguem simular diretamente a normal, mas tem simuladores da distribuição uniforme. Uma forma rápida e prática de gerar normais a partir da uniforme é a transformação de Box-Muller: sejam e

valores independentes gerados pela distribuição uniforme entre 0 e 1. Então:

e

são normais padronizadas independentes.

| |

Esta página usa conteúdo da Wikipedia. O artigo original estava em Distribuição normal. Tal como o Think Finance neste artigo, o texto da Wikipedia está disponível segundo a GNU Free Documentation License. |