Correlação

<metadesc content="Na teoria das probabilidades e na estatística, correlação (frequentemente medida na forma de um coeficiente de correlação) indica a força e a direcção da relação linear entre duas variáveis aleatórias." />

Na teoria das probabilidades e na estatística, correlação (frequentemente medida na forma de um coeficiente de correlação) indica a força e a direcção da relação linear entre duas variáveis aleatórias. Esta definição difere do uso normal do termo correlação, que se refere a qualquer relação, não necessariamente linear.

No uso geral em estatística, correlação refere-se à medida em que duas variáveis aleatórias se afastam da independência estatística. Neste sentido geral, existem vários coeficientes para medir o grau de correlação, adaptados à natureza dos dados.

Índice

Coeficiente produto-momento de Pearson

Vários coeficientes são utilizados para situações diferentes. O mais conhecido é o coeficiente de correlação de Pearson, o qual é obtido dividindo a covariância de duas variáveis pelo produto dos seus desvios padrão. Apesar do nome, ela foi inicialmente apresentada por Francis Galton<ref name="13ways"> Rodgers, J. L.; Nicewander, W. A. (1988). "Thirteen ways to look at the correlation coefficient" (em inglês). The American Statistician 42: 59–66. DOI:10.2307/2685263. </ref>.

Propriedades matemáticas

O coeficiente de correlação ρX, Y entre duas variáveis aleatórias X e Y com valores esperados μX e μY e desvios padrão σX e σY é definido como

onde

é o operador valor esperado e

significa covariância.

Uma formulação alternativa, expressa unicamente em termos dos valores esperados, é possível dado que

e

e que o mesmo se verifica de forma semelhante para , e dado também que

temos

A correlação é definida somente se ambos os desvios padrão são finitos e diferentes de zero. Pelo corolário da desigualdade de Cauchy-Schwarz, a correlação não pode exceder 1 em valor absoluto.

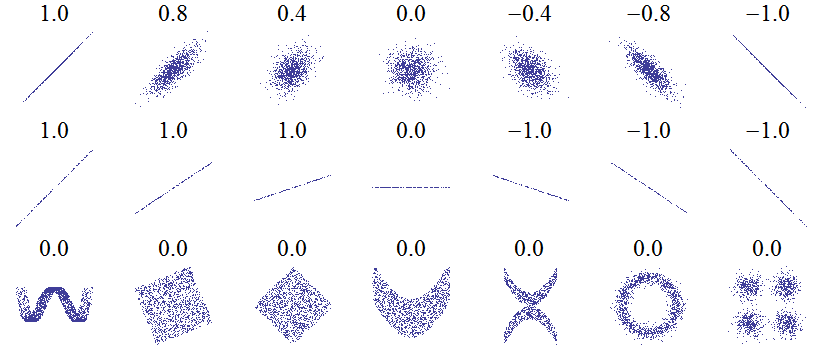

A correlação é 1, ou correlação positiva, quando ao aumento de uma variável corresponde um aumento da outra. A correlação é -1, ou correlação negativa, quando ao aumento de uma variável corresponde uma diminuição da outra. A correlação toma um valor intermédio em todos os restantes casos, indicando o grau de dependência linear entre as variáveis. Quando mais o coeficiente for aproximado de 1 ou de -1, mais forte é a correlação entre as variáveis.

Se as variáveis forem independentes então a correlação será 0, mas o inverso não se verifica porque o coeficiente de correlação só detecta dependências lineares entre as variáveis. Como forma de exemplo, suponha que a variável aleatória X está uniformemente distribuída pelo intervalo desde -1 até 1, e que Y = X2. Então Y é completamente determinado por X, de forma que X e Y são dependentes, mas a sua correlação é zero; não estão correlacionados.

Uma correlação entre duas variáveis dilui-se na presença de erros de medição causados pela estimação de uma ou de ambas as variáveis, em cujo caso a disatenuation fornece um coeficiente mais preciso.

Referências

Links relevantes

Gerais

- Earliest Uses: Correlation (em inglês), primeiro usos do termo correlação e algumas referências.

- Online Utility to Compute Correlation Coefficient (Scatter Diagram) (em inglês), aplicação de cálculo do coeficiente de correlação e diagrama de dispersão

- Understanding Correlation (em inglês), material introdutório por um professor da Universidade do Havai.

- Coeficiente de correlação de Pearson (em inglês), método de cálculo rápido

- Learning by Simulations (em inglês), a distribuição do coeficiente de correlação